draft

萧箫 发自 凹非寺

量子位 | 公众号 QbitAI只需给大模型“加点小零件”,推理速度立刻提升2倍!

不需要额外训练一个模型,也不需要对计算硬件做优化,单张A100最快几小时就能微调完成。

这项新研究名叫Medusa(美杜莎),来自普林斯顿、UIUC、CMU和康涅狄格大学,FlashAttention作者Tri Dao也在其中。

目前,它已经成功部署到伯克利70亿参数的“骆马”Vicuna中,后续还会支持其他大模型,已经登上GitHub热榜:

但其实,在这种方法推出之前,业界并非没有大模型推理加速方法,主流的就是DeepMind推出的投机采样(speculative decoding)。

相比这种方法,Medusa有什么不一样的地方?

投机采样的2个“bug”

要想加速大模型推理,需要先知道究竟是什么“限制”了它的速度。

相比计算量的增加,大模型推理速度更容易受到内存带宽的影响(memory bound)。

这是因为,大模型由于参数量巨大、远超缓存容量,因此推理时需要先把权重从外部内存(显存)读取一次到缓存中,这个过程受内存带宽限制,速度通常很慢。

因此,模型做批量推理(batch inference)时,一次处理100个tokens和一个tokens时间上区别不大。

基于这个特点,DeepMind去年11月想出了一个名叫投机采样的神奇操作——

训练一个更小的模型(draft模型),给大模型提前生成一批“候选词”,相比于让大模型自己“思考”生成,直接做“选择”就好。

由于小模型生成速度比大模型快好几倍,一旦大模型觉得小模型已有的词“可用”,就直接拿来,不用自己再缓慢生成一遍。

这个过程,有点像是输入法的联想词候选,在我们(大模型)想好下一个词用什么之前,输入法(小模型)先给列出一些备选项:

要是看到觉得不错,就从中选一个用;要是觉得生成的都不行,就pass掉自己重新打。

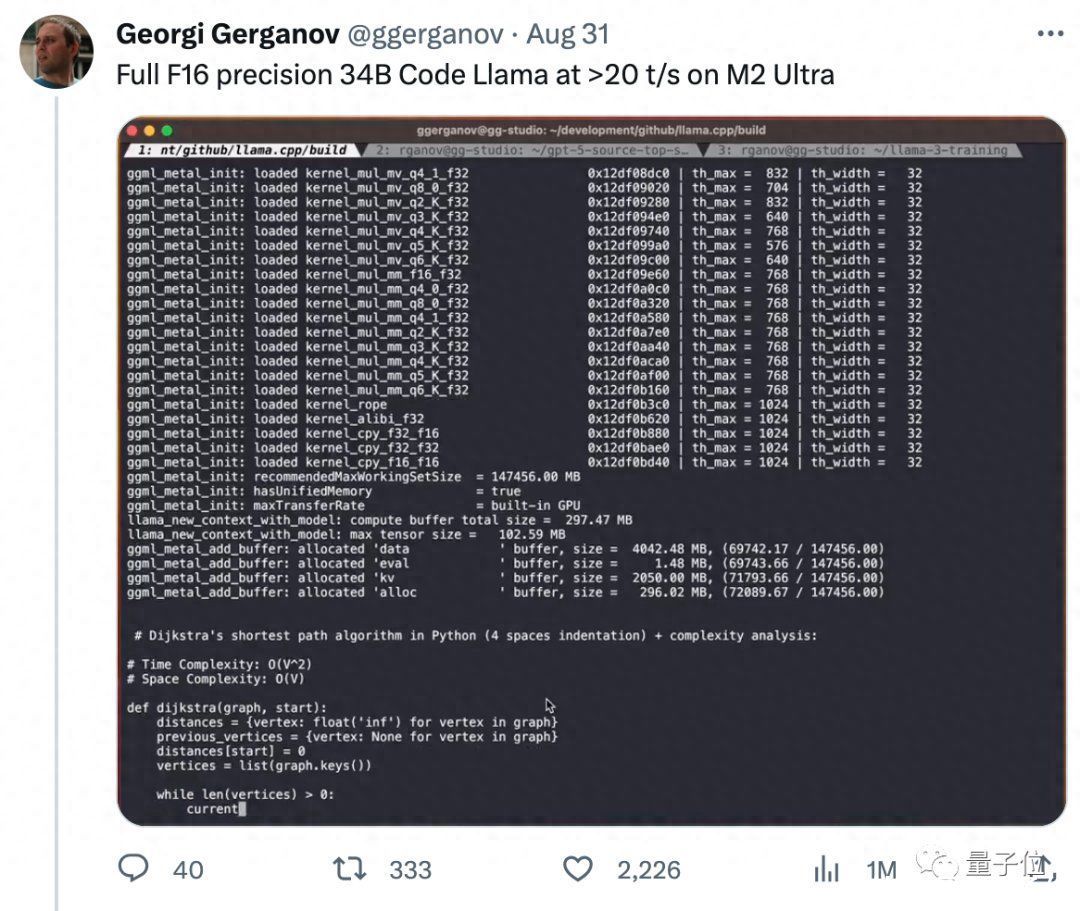

这种投机采样方法确实取得了显著成效,甚至能轻轻松松在M2 Ultra上以高精度跑340亿参数LLaMA大模型。

BUT,这种方法存在两个问题。

一方面,给大模型找个生成“候选词”的draft小模型,没那么容易。

这个小模型可不是随便抓个生成模型就能用,除了接口统一、概率分布接近等要求,生成质量也不能比大模型差太多。

对于Meta发布的LLaMA这种模型可能还好,既有几百亿参数的大模型版本,又有几十亿参数的小模型版本,可以把参数量更小的版本拿来当draft模型使用。

但对于其他开源大模型,这种方法就不太适用了,自己去搭建训练一个小模型,不仅时间成本更高,生成效果可能还不达预期。

另一方面,双模型的组合,使得后续要想做系统调优变得更复杂。

这是因为,相比于大模型自身是一个系统,新增加的draft模型相当于又引入了一个系统。

这样会导致模型部署起来更复杂,包括额外的网络传输、不同的硬件条件都需要考虑到,在做计算优化时难度也会进一步提升。

为了解决这些问题,Medusa出现了。

不用小模型,加几个“头”就行

Medusa(美杜莎,一种长有多个头的妖怪)是一种新的大模型推理加速方法。

相比投机采样,它选择直接给Transformer大模型多加几个解码头(decoding heads),每个头都是一个单层前馈网络。

这几个多出来的解码头,可以让大模型直接一次多生成几个词,而不是“挤牙膏式”一个一个生成。

生成准确率也还可以,在预测“下一个词的下一个词”时,Medusa准确率达到了60%,还在不断优化中。

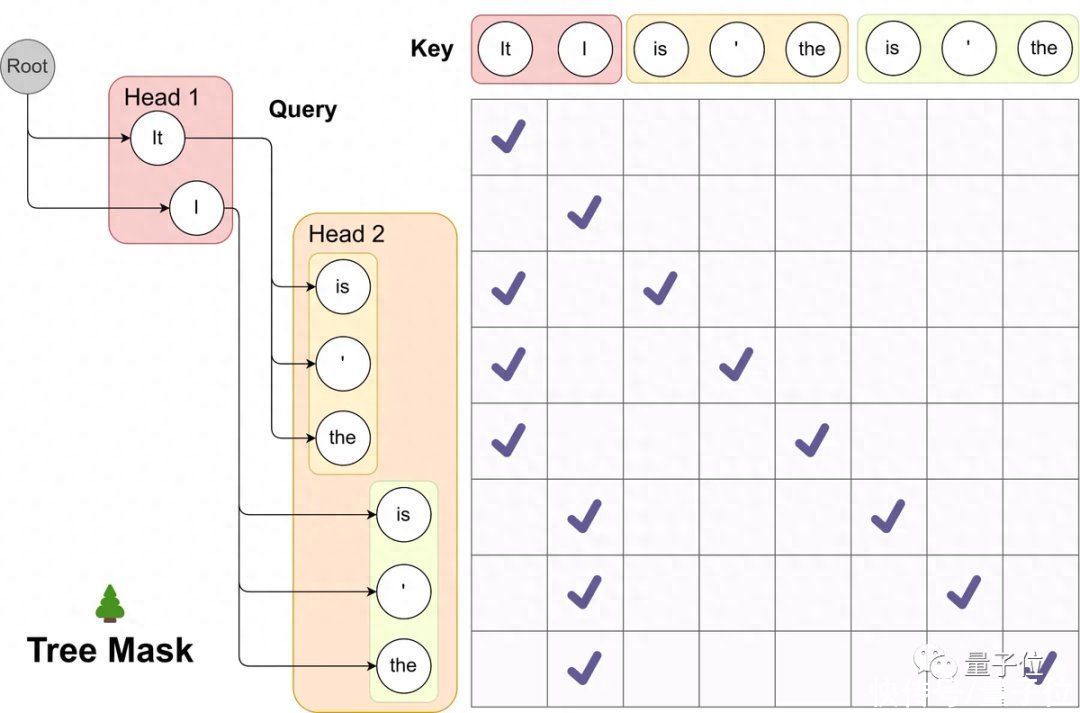

随后,结合树状注意力机制(tree-based attention mechanism)并行验证这些词,从而实现推理加速。

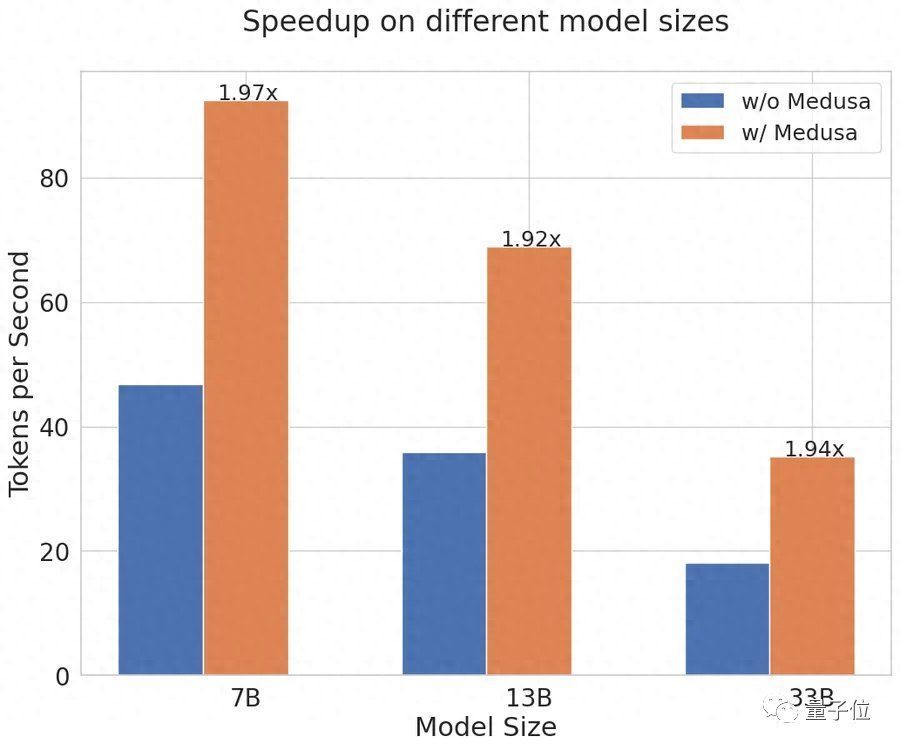

基于Medusa,Vicuna的70亿、130亿和330亿参数大模型推理速度,均有了1.9倍以上的效率提升:

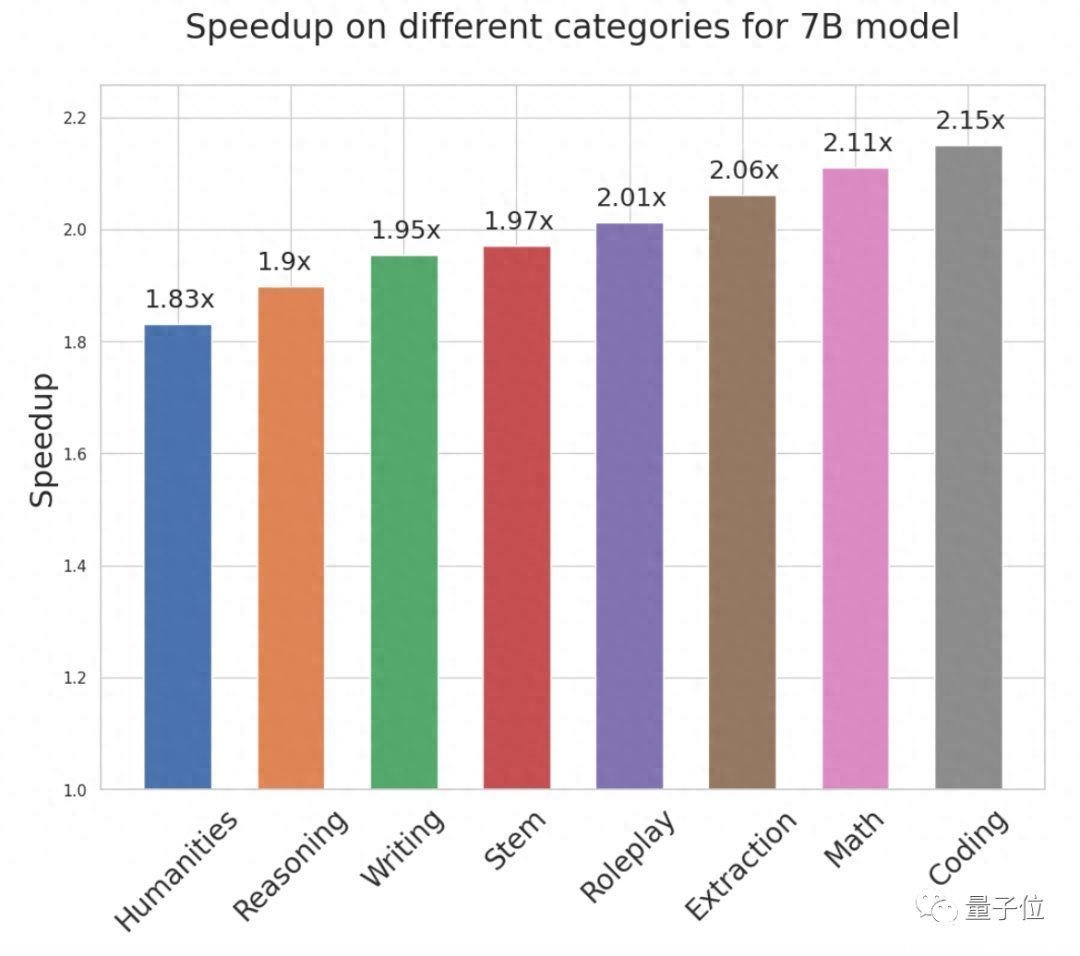

针对70亿参数的模型,研究者们还在不同任务上测试了一下加速效果,显示最高在代码生成上有2.15倍的速度提升。

最关键的是,用上Medusa后,并不需要将整个大模型重新训练一遍。

相比之下,它可以和大模型一起训练,只需要冻结大模型的参数就行,甚至单个GPU就能搞定。

由于不增加额外的模型,对于分布式推理也很友好。

作者介绍

这项研究有两位共同一作。

共同一作蔡天乐,普林斯顿大学博士生,研究方向包括优化、表示学习、架构设计等,本科毕业于北京大学数学科学学院,获得应用数学和计算机科学双学位。

共同一作Yuhong (Jesse) Li,伊利诺伊大学香槟分校(UIUC)博士生,研究方向是高效机器学习,本科毕业于北京邮电大学。

此外,这项研究也有FlashAttention作者、斯坦福博士Tri Dao的参与。

FlashAttention是一种能加快注意力并减少内存占用的方法,相比PyTorch标准注意力实现,最高能提速9倍。

GitHub地址:

https://github.com/FasterDecoding/Medusa研究地址:

https://sites.google.com/view/medusa-llm— 完 —

量子位 QbitAI · 头条号签约

","gnid":"9c93ea2fbb8fc740b","img_data":[{"flag":2,"img":[{"desc":"","height":"468","s_url":"https://p0.ssl.img.360kuai.com/t017c2335a18756fffe_1.gif","title":"","url":"https://p0.ssl.img.360kuai.com/t017c2335a18756fffe.gif","width":"576"},{"desc":"","height":"350","title":"","url":"https://p0.ssl.img.360kuai.com/t01b43c107bc74a0a54.jpg","width":"1080"},{"desc":"","height":"209","title":"","url":"https://p0.ssl.img.360kuai.com/t017f6b27faa049e354.jpg","width":"1080"},{"desc":"","height":"1200","title":"","url":"https://p0.ssl.img.360kuai.com/t011910f5d10b32bc90.jpg","width":"1216"},{"desc":"","height":"229","title":"","url":"https://p0.ssl.img.360kuai.com/t011fb1b54707c800a2.jpg","width":"1080"},{"desc":"","height":"440","title":"","url":"https://p0.ssl.img.360kuai.com/t011d4c9f5a654615c9.jpg","width":"1268"},{"desc":"","height":"911","title":"","url":"https://p0.ssl.img.360kuai.com/t0168fe528ff84ddb87.jpg","width":"1080"},{"desc":"","height":"890","title":"","url":"https://p0.ssl.img.360kuai.com/t0194acfd6dbd85ba1a.jpg","width":"1080"},{"desc":"","height":"713","title":"","url":"https://p0.ssl.img.360kuai.com/t0153d579e3e3154bb3.jpg","width":"1080"},{"desc":"","height":"750","title":"","url":"https://p0.ssl.img.360kuai.com/t01319b0d25bb0f6f5e.jpg","width":"900"},{"desc":"","height":"956","title":"","url":"https://p0.ssl.img.360kuai.com/t015866b5c475ecf1c9.jpg","width":"1080"},{"desc":"","height":"604","title":"","url":"https://p0.ssl.img.360kuai.com/t01708428e22f288118.jpg","width":"604"},{"desc":"","height":"1280","title":"","url":"https://p0.ssl.img.360kuai.com/t0154e05249c52f2336.jpg","width":"720"},{"desc":"","height":"1280","title":"","url":"https://p0.ssl.img.360kuai.com/t0198b194811d189e9d.jpg","width":"962"}]}],"original":0,"pat":"art_src_3,fts0,sts0","powerby":"pika","pub_time":1694927760000,"pure":"","rawurl":"http://zm.news.so.com/4fd4f974bad19ef1c4f6c19384d9c382","redirect":0,"rptid":"15e7d7aa1652ab4c","rss_ext":[],"s":"t","src":"量子位","tag":[{"clk":"ktechnology_1:github","k":"github","u":""}],"title":"大模型生成提速2倍!单GPU几小时搞定微调,北大数院校友共同一作

巩顷瑞1522draft做何译 -

车忠侵18687652564 ______ Thirsty fans even drank dry the draft supplies of Tsingtao beer. Manager Greg Dover said: "We haven't had that before, but luckily we had other beers on draft.结合上下文,draft在这里是散装啤酒的意思~~~~ 首先,给FANS们聚会喝酒,一般都选...

巩顷瑞1522进出口贸易中bill of exchange与draft的区别 -

车忠侵18687652564 ______ 应该没有什么区别,只是说法不同.在同等语境里,好比 DAD 和 FATHER的区别.汇票(Draft/Bill of Exchange)是由一人开致另一人的书面的无条件命令,由发出命令的人签名,要求接受命令的人在索款要求时立即,或在固定时间,或在可以确定的将来时间,把一定金的货币支付给一个特定的人,或他的指定人,或来人.(英国《票据法

巩顷瑞1522make a draft是什么意思?draft还有什么其他意思?谢谢各位 -

车忠侵18687652564 ______[答案] 拟稿 起草 起稿. draft n.草稿;汇票;草图;[篮球]选秀 vt.起草,设计;为...打样 汇票 吃水 草稿

巩顷瑞1522qingdao draft beer这里的draft是什么意思啊? -

车忠侵18687652564 ______ draft有“草稿、草图、”的意思,生啤酒就是啤酒的草稿嘛!很形象!draft beer.生啤酒 还与下列意思有关!on draft=Drawn from a large container, such as a keg.散装的,直接汲取的:从一个大容器中汲取的,如酒桶

巩顷瑞1522SKETCH和 DRAFT的区别 -

车忠侵18687652564 ______ DRAFT指手稿 草稿 不局限于单独的图或文字 sketch是特指草图 不是文字 多用于设计领域

巩顷瑞1522they will accept your draft on them at 30 days after sight for the amount of your invoices这句话中的draft是什么意思 -

车忠侵18687652564 ______[答案] 他们按照你的发票金额会承兑你30天期的汇票 draft在此语境中指 汇票

巩顷瑞1522Protocol,Agreement,Contract,Draft几个词有何区别 -

车忠侵18687652564 ______ 都表示协议,程度不一样,protocol最正式,表示准则.agreement协议,协定.contract合约,合同.draft表示草案,或者议案.

巩顷瑞1522bill of exchange和draft有什么区别我知道两者都有汇票的意思 但是这两者到底有什么区别啊 -

车忠侵18687652564 ______[答案] 没有区别. Bill of exchange,draft,acceptance bill 都是汇票的意思,是可以互换使用的词语. 汇票其实是一种非正式的金钱保证.和bond(债券)不同,汇票是没有100%约束力的.

巩顷瑞1522英文一篇draft怎么样写 -

车忠侵18687652564 ______ rway beyond which he would be able to

巩顷瑞1522“协议草案”的英语是“draft agreement”还是“agreement draft”? 为什么? -

车忠侵18687652564 ______ 这里的draft是形容词.所以是 draft agreement.