求y关于x的回归直线方程

线性回归可以理解为一个回归算法,我们可以结合线性回归算法来做预测值。这篇文章里,作者就总结了线性回归算法的基本原理、应用场景、优劣势等方面,一起来看看吧。

前两篇文章我们介绍了两个解决分类问题的算法:K近邻和朴素贝叶斯,今天我们一起来学习回归问题中最经典的线性回归(Linear Regression)算法。

一、基本原理

生活中,大家都排过队,我印象最深的应该是排队做核酸的队伍,前后间隔一米,随着做核酸的人越来越多,新来的人看到队伍,都会自动排到队伍的末尾,同样间隔一米,大家“齐心协力”排出了一条长线。

有了这条长线之后,我们就可以对新来的人排队的位置做出预测,这就是线性回归的基本逻辑。

所以线性回归算法的思路就是:根据已有的数据去寻找一条“直线”,让它尽可能的接近这些数据,再根据这条直线去预测新数据的结果。

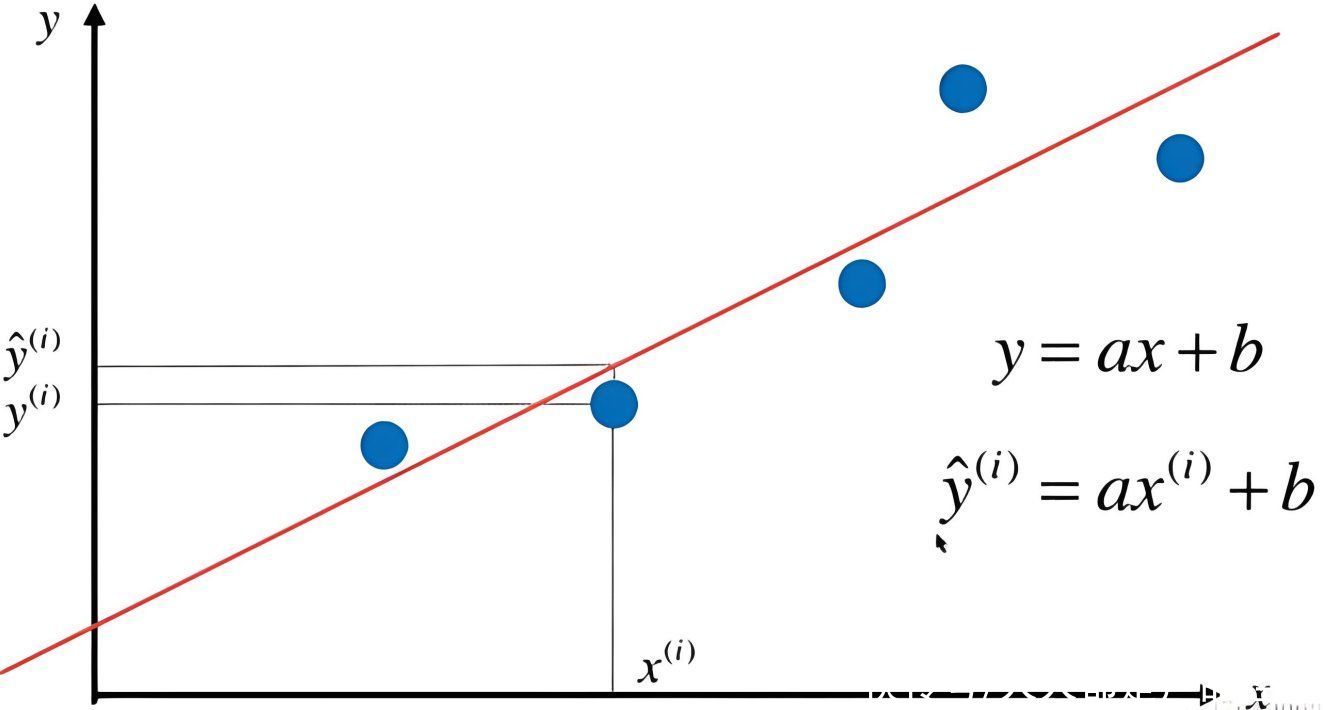

那么具体要怎么找这条“直线”呢?初中数学里描述一条直线时,用的是一元一次方程:y=ax+b,这里的a表示直线的斜率,b表示截距,如下图所示:

以排队为例,我们已知x是人的顺序,y是排的位置,将已有的x和y数据代入到公式中,可以得到一组合适a和b的值来描述这条直线,也就是我们找到了这条直线的分布。

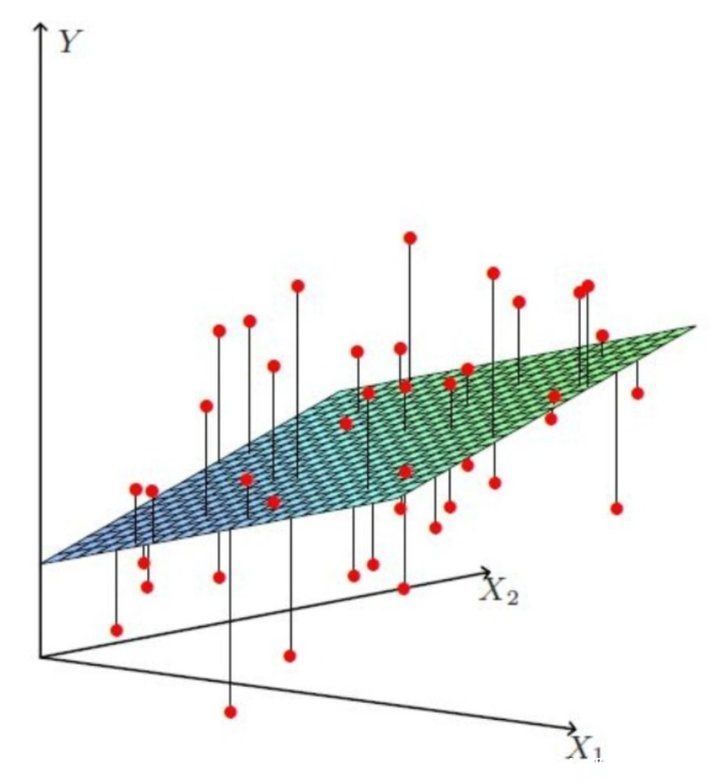

排队的例子比较简单,只有一个x变量,在实际的应用中,会有很多个影响结果的变量,比如预测贷款额度时,会有工资、是否有房等变量,用线性回归的思路解决类似的问题,就要构建多元回归方程了,公式也就变成了 y = a1x1 + a2x2 + … + b。

当有两个变量时,线性回归的分布也就不是一条简单的直线了,而是一个平面,如下图所示:

如果有更多的变量,分布就是一个超平面,找到它的分布也会变得更复杂。

二、如何计算最优解

如果每个人的站位(实际值)距离理想站位(预测值)的距离(误差)最小,那就说明我们得到的线性回归分布是最优解。

机器学习中,评价模型的预测值和实际值差异的公式叫做损失函数,损失函数值越小,模型性能越好。

平方残差和就是一种场景的损失函数,其计算公式为 loss=SUM(真实值-预测值)²,就是把每个节点的预测差求平方再求和,前面回归模型评估的文章里提到的MSE就是平方残差和除以样本数量。

三、应用场景

线性回归的应用场景非常广泛,只要数据是符合线性分布的,理论上都可以用线性回归来进行预测:

- 预测房价:通过分析房屋特征(如面积、位置、房间数量等)与价格之间的关系。

- 预测员工绩效:通过分析员工的教育背景、工作经验、培训等因素与绩效之间的关系。

- 营销分析:分析市场调研数据,预测产品销售量,并确定哪些因素对销售量有显著影响。

- 交通规划:预测交通流量,通过分析道路特征、人口密度等因素与交通流量之间的关系。

- 环境科学:分析环境数据,如气候变化、污染物排放等因素与生态系统的影响。

四、优缺点

线性回归算法的优点:

- 简单而直观:易于理解和解释,适用于初学者入门。

- 计算效率高:计算速度较快,适用于大规模数据集。

- 可解释性强:可以提供每个特征对目标变量的影响程度,有助于理解变量之间的关系。

- 可扩展性强:可以通过添加交互项、多项式特征等进行扩展,以适应更复杂的数据模式。

线性回归算法的缺点:

- 仅适用于线性关系:线性回归假设自变量与因变量之间存在线性关系,对于非线性关系的数据拟合效果较差。

- 对异常值敏感:线性回归对异常值较为敏感,异常值的存在可能会对模型的拟合产生较大影响。

- 忽略了特征之间的复杂关系:线性回归无法捕捉到特征之间的非线性、交互作用等复杂关系。

- 对多重共线性敏感:当自变量之间存在高度相关性时,线性回归模型的稳定性和可靠性可能会受到影响。

五、总结

本文我们介绍了线性回归算法的原理、应用场景和优缺点,线性回归是一个回归算法,常用来做预测值,和之前介绍的分类模型的输出是有区别的,需要注意一下。

下篇文章,我们来聊一聊逻辑回归算法,敬请期待。

本文由 @AI小当家 原创发布于人人都是产品经理,未经许可,禁止转载

题图来自 Unsplash,基于 CC0 协议

该文观点仅代表作者本人,人人都是产品经理平台仅提供信息存储空间服务。

","gnid":"986e0d62b5c4aaf5e","img_data":[{"flag":2,"img":[{"desc":"","height":"420","title":"","url":"https://p0.ssl.img.360kuai.com/t01b35250c3375c56e0.jpg","width":"900"},{"desc":"","height":"710","title":"","url":"https://p0.ssl.img.360kuai.com/t01e230685f98f732cc.jpg","width":"1323"},{"desc":"","height":"783","title":"","url":"https://p0.ssl.img.360kuai.com/t01dda68d216e4588bb.jpg","width":"720"}]}],"original":0,"pat":"art_src_3,sexf,sex4,sexc,fts0,sts0","powerby":"cache","pub_time":1705890180000,"pure":"","rawurl":"http://zm.news.so.com/f1804ee21bcc84664ec444b1a1980982","redirect":0,"rptid":"6c6c54f1e1479e00","rss_ext":[],"s":"t","src":"人人都是产品经理","tag":[],"title":"线性回归算法:用“线性外推”的思路做预测

尤柔雯988求助回归直线方程

瞿炉舒17766335499 ______ 若:在一组具有相关关系的变量的数据(x与Y)间,通过散点图我们可观察出所有数据点都分布在一条直线附近,这样的直线可以画出许多条,而我们希望其中的一条最好地反映x与Y之间的关系,即我们要找出一条直线,使这条直线“最贴近”...

尤柔雯988回归直线求法及过程? -

瞿炉舒17766335499 ______ 经典最小二乘法是求直线回归方程的常用方法,但当数据中存在异常值时,这种方法较敏感,本文给出了二类求稳健回归直线的方法,并将它们统一在迭代再加权最小二乘统一算法之下,模拟结果及实例分析表明这些方法在抗异常值方面较最小二乘法为优.

尤柔雯988已知x与y之间的一组数据如下表,根据表中提供的数据,求出y关于x的线性回归方程为 y =bx+0. -

瞿炉舒17766335499 ______ 由题意, . x = 3+4+5+6 4 =4.5, . y = 2.5+3+4+4.5 4 =3.5 代入线性回归方程 y =bx+0.35 ,可得3.5=b*4.5+0.35,解得b=0.7 故选C.

尤柔雯988根据下表所示的统计资料,求出了y关于x的线性回归方程为 y=1.23x+0.08,则统计表中t的值为( ) x23456y2.23.8t6.57.0 -

瞿炉舒17766335499 ______[选项] A. 5.5 B. 5.0 C. 4.5 D. 4.8

尤柔雯988下表是x与y之间的一组数据,则y关于x的线性回归方程y=bx+a必过点( ) x 0 1 2 3 y 1 -

瞿炉舒17766335499 ______ ∵ . x = 0+1+2+3 4 =1.5, . y = 1+3+5+7 4 =4, ∴本组数据的样本中心点是(1.5,4), ∴y与x的线性回归方程为y=bx+a必过点(1.5,4) 故选D.

尤柔雯988回归方程怎么算 x 14 16 18 20 22 Y 12 10 7 5 3 (1)求Y关于X的回归方程 (2)求出相关指数R的平方 -

瞿炉舒17766335499 ______[答案] 7674777667377477y77;47774

尤柔雯988已知一组变量x与y具有相关关系,对应值如下表:根据上表提供的数据,求出y关于x的线性回归方程为y=0.5x+1 -

瞿炉舒17766335499 ______ ∵. x =3+4+5+6 4 =4.5, y =0.5x+1.25,∴. y =0.35,∴3.5+t+4+4.5 4 =3.5,解得t=2,故选:A.

尤柔雯988 下面是两个变量的一组数据, 求x与y两个变量之间的回归直线方程. -

瞿炉舒17766335499 ______[答案] 根据表中的数据,可以计算出有关数据,列成下表, ∴有, ∴=9, , 于是回归直线方程为.

尤柔雯988已知x与y之间的一组数据为:则y与x的回归直线方程y=bx+a必过定点 - -----. -

瞿炉舒17766335499 ______ ∵回归直线方程必过样本中心点,∵ . x = 0+1+2+3 4 = 3 2 . y = 1+3+5-a+7+a 4 =4 ,∴样本中心点是( 3 2 ,4) ∴y与x的回归直线方程y=bx+a必过定点( 3 2 ,4) 故答案为:( 3 2 ,4)

尤柔雯988回归直线方程为y=0.5x - 0.81,则x=25时,y的估计值为______. -

瞿炉舒17766335499 ______[答案] ∵回归直线方程为 ̂ y=0.5x−0.81, ∵x=25 ∴y=0.5*25-0.81=12.5-0.81=11.69, 故答案为:11.69